Der Film »Lo and Behold – Wovon träumt das Internet?« des Regisseurs Werner Herzog geht in seinen zehn Kapiteln der Geschichte des Internets und dessen Auswirkungen auf unsere Gesellschaft nach. In Gesprächen werden beispielsweise »Die Herrlichkeit des Netzes«, »Die dunkle Seite«, »Internet auf dem Mars« oder die Zukunft des Netzes thematisiert. Gesprächspartner sind dabei Leonard Kleinrock, Elon Musk, Sebastian Thrun sowie viele weitere wichtige Protagonisten dessen tägliche Arbeit vom Internet bestimmt wird oder deren Leben durch das Netz massiv verändert wurde. Wie in meiner Dokumentation üblich, möchte ich keine Filmrezension schreiben, sondern lediglich die wichtigen Punkte herauspicken. Vor allem die Kapitel »Künstliche Intelligenz« und »Das Internet des Ichs« sind dabei spannend für mich.

In ersterem prophezeit Sebastian Thrun, dass wir an einen Punkt kommen werden, an dem fast alles von Maschinen übernommen werden kann und dass sie das meiste besser als wir Menschen können. Das liegt unter anderem daran, dass Maschinen sehr viel schneller lernen.1 Zudem erklärt er schon zuvor, dass die Fehler, die selbstfahrende Autos machen, sofort mit anderen – auch »ungeborenen« – Autos geteilt werden. Dadurch wird dieser Fehler niemals wiederholt, was ein enormer Vorteil gegenüber menschlichen Fahrern ist.2

Theologische Revolution

Solche grundlegenden Veränderungen, die durch das Internet und die Maschinen, die für uns denken, einhergehen, benötigen laut Computerwissenschaftler Danny Hillis eine Veränderung unserer Moral. Wir müssten über die Definition, was menschlich sein wirklich bedeutet, nachdenken und er sagt eine theologische Revolution voraus. Wir ergründen und entwickeln eine neue Gesellschaft sowie neue Ideen darüber, was richtig und falsch ist. Er sieht die momentane Zeit zudem als eine unglaublich kreative Zeit in der Menschheitsgeschichte – nicht nur technologisch, sondern auch moralisch und kulturell.3 Dieser Gedanke ist dem Luciano Floridis, der von einer neuen Informationsphilosophie spricht, sehr nahe. Auch er ist der Meinung, dass die Entwicklung einer neuen Philosophie notwendig ist, um dem rasanten Wandel, dem unsere Zeit unterliegt, gerecht zu werden.

Das digitale Mittelalter

Der Computerwissenschaftler sieht eine weitere Entwicklung, die den Gedanken Floridis sehr ähnlich ist. Während der Informationsphilosoph es als »Digitalen Gedächtnisverlust« formuliert (Die Hypergeschichte »), spricht Hillis vom »Digitalen Mittelalter«. Seinen Beobachtungen nach passieren heutzutage viele Dinge deren Hintergründe später nicht mehr nachvollziehbar sind. Während es noch handschriftliche Briefe der Gründerväter der USA gibt, wird heute vieles per E-Mail geklärt. Diese Unterhaltungen vorweg werden höchstwahrscheinlich also nicht mehr rekonstruierbar sein und verloren gehen.4 Während die Ausführung beider ziemlich unterschiedlich sind, entsprechen sie sich im Kern doch sehr. Im Grunde geht es bei beiden um eine nicht vorhandene oder verlorene Historie, welche es den Generationen nach uns sehr schwierig machen wird, die Hintergründe zu verstehen.

Das unsichtbare Internet

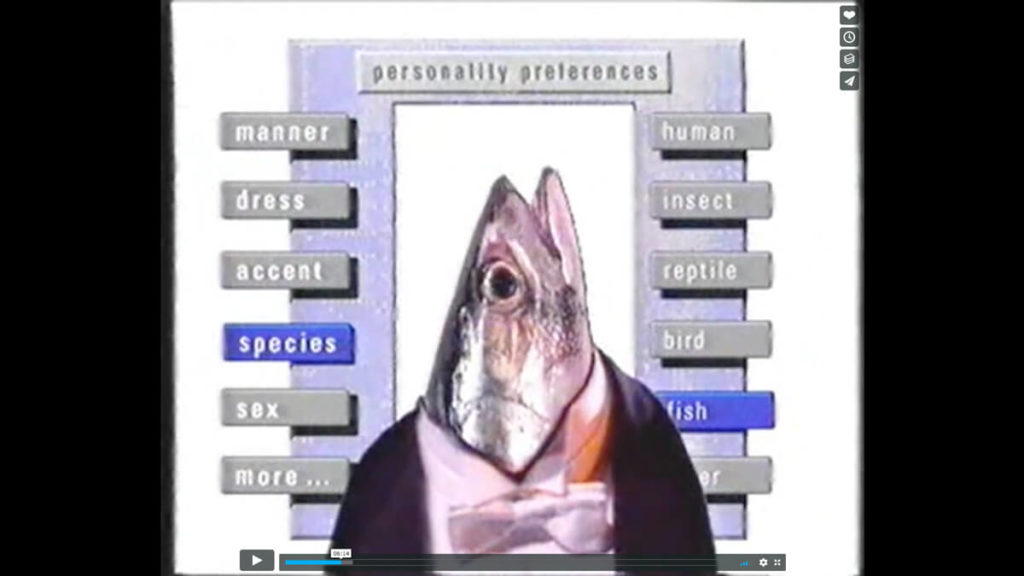

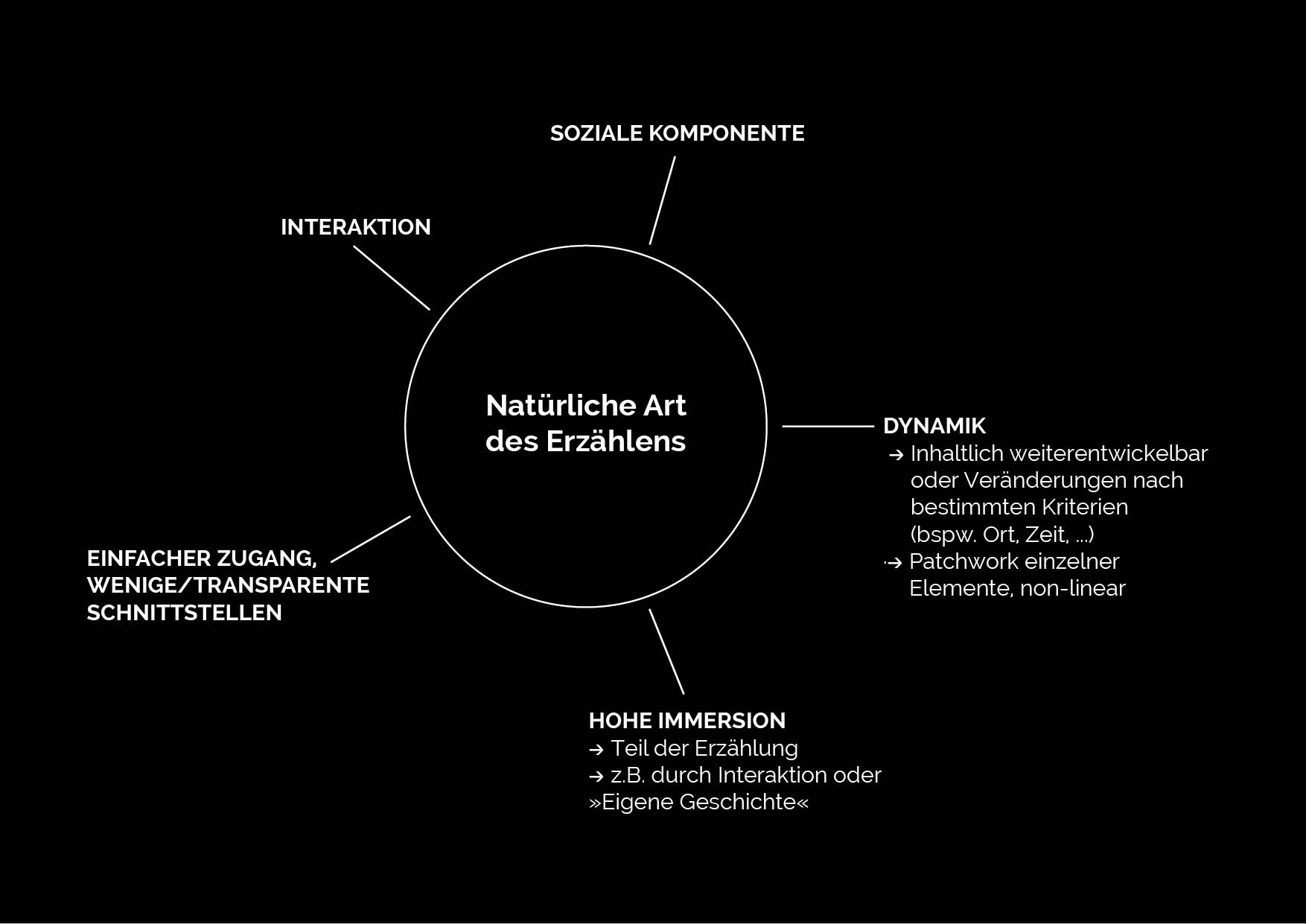

Während meines Researchs beschäftigt mich immer wieder das Verschwinden von Schnittstellen. Technologie wird zunehmend unsichtbar und rückt in den Hintergrund. Der Internetpionier Leonard Kleinrock erläutert im Film, dass ein Raum wissen müsste, wenn man da ist. Er spricht von Voice User Interfaces, so dass man mit der Technologie kommunizieren kann, welche wiederum mit Sprache, einem Hologram oder einem Display auf natürliche Weise antworten kann. Auch Gesten, Berührungen oder sogar das Miteinbeziehen des Geruchssinns hält er für möglich. Er vergleicht sie dabei mit der Elektrizität, welche einfach unsichtbar in unseren Wänden eingelassen ist. Zu dieser Unsichtbarkeit müsste sich das Internet jedoch noch entwickeln.5 Ähnlich sieht das der Sicherheitsanalytiker Sam Curry, welcher von Räumen spricht, in denen das Licht nach eigenen Vorlieben gedimmt oder die Musik angeschaltet wird, wenn man den Raum betritt.6 Vor allem der letzte Ansatz eines Smart Homes, ist heutzutage teilweise schon möglich. So können beispielsweise HUE-Lampen eingeschaltet werden, sobald sich das Smartphone mit dem W-LAN verbindet oder Lampen von z. B. Trilux je nach Tageslicht gesteuert werden.

Abschließend liefert mir der Film »Lo and Behold – Wovon träumt das Internet?« leider kaum neue Erkenntnisse oder Ansätze, welche ich für meine Master-Arbeit verwenden kann. Die interessanten Gedanken habe ich hier für mich zusammengefasst, jedoch habe ich vor allem im Hinblick darauf, dass Elon Musk oder Ted Nelson Teil des Films sind, mehr erwartet.

Quellen

- Vgl. Herzog, Werner: »Lo and Behold – Wovon träumt das Internet?«, 98 Minuten, Vereinigte Staaten 2016 [Deutschland 2017], TC: 01:23:30–01:24:22, VIII. Künstliche Intelligenz.

- Vgl. Ebd., TC: 00:34:56–00:36:18, II. Die Herrlichkeit des Netzes.

- Vgl. Ebd., TC: 01:24:23–01:25:08, VIII. Künstliche Intelligenz.

- Vgl. Ebd., TC: 01:29:46–01:30:20, IX. Das Internet des Ichs.

- Vgl. Ebd., TC: 01:26:17–01:27:20, IX. Das Internet des Ich.

- Vgl. Ebd., TC: 01:27:20–01:28:28, IX. Das Internet des Ich.